ROCKPro64 Übersicht - was geht? **veraltet**

-

schrieb am 12. Juni 2018, 14:05 zuletzt editiert von FrankM

Benutzt habe ich folgendes

Kernel/Images

- Kernel 4.18.0-rc3-1046

- Kernel 4.4.132 / 0.7.7

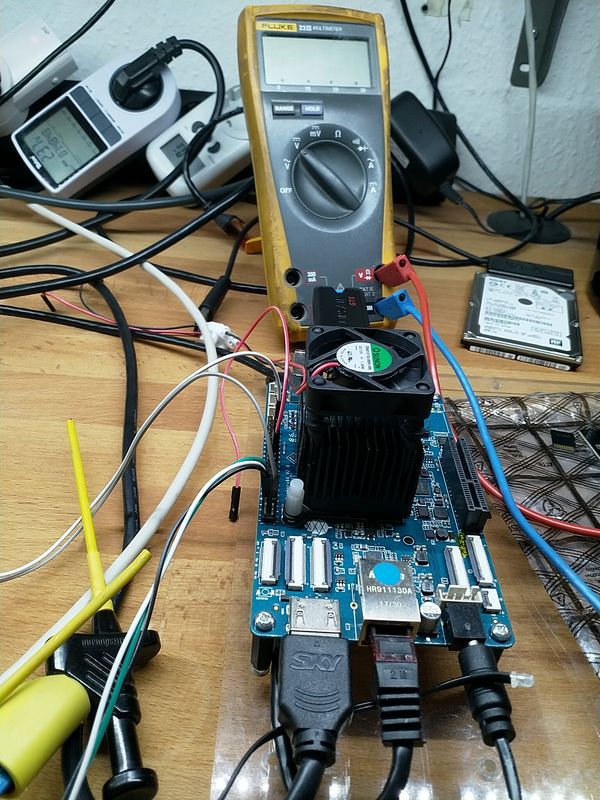

Hardware

- ROCKPro64 4GB

- irgendeine SD-Karte

- Samsung 960 EVO m.2 mit 256GB

- Samsung 860 PRO mit 256GB

Funktion 4.4.154 Bemerkungen 4.19.0 Bemerkungen WLan Ja Image Mr. Fixit (4.4.169) LAN 941/937 Mbit/s 97 MB/s 942/942 Mbit/s 90 MB/s (iperf3 -c / iperf3 -s) USB2 29 MB/s 29.0 MB/s USB3 335 MB/s 250 MB/s 860 PRO 256GB USB-C Ja USB-OTG (640 Mbit/s ) --- PCIe 388 MB/s (5GT/s) x4 bis zu 413 MB/s (5GT/s) x4 SATA Ja 96,8 MB/s (2,5 Zoll 1TB HDD // 122 MB/s 2,5 Zoll SSD) HDMI Ja Ja Power OFF Ja LED's aus Ja LED rot Suspend Power Button Ja ca. 1,4 W Nein Suspend Modul fehlt im Mainline Reboot Ja Ja USB-Boot Ja Ja USB2 - ok / USB3 - USB-Stick & USB3-to-SATA Adapter (nur mit aktivem Hub!) SPI Flash Ja Ja Flash-Image SPI Erase Ja Ja Erase-Image eMMC Boot Ja Ja Sound ja (HDMI) Line Out (System crasht) --- no soundcards --- GPU -- -- -- -- Energieverbrauch 5,3 W 4,2 W Idle / PCIe mit 960er EVO m.2 (4.18.0-rc3-1042) rock64@rockpro64:/mnt$ lsusb Bus 004 Device 001: ID 1d6b:0003 Linux Foundation 3.0 root hub Bus 003 Device 001: ID 1d6b:0002 Linux Foundation 2.0 root hub Bus 002 Device 001: ID 1d6b:0001 Linux Foundation 1.1 root hub Bus 001 Device 001: ID 1d6b:0002 Linux Foundation 2.0 root hub Bus 006 Device 001: ID 1d6b:0001 Linux Foundation 1.1 root hub Bus 005 Device 002: ID 2109:0715 VIA Labs, Inc. Bus 005 Device 001: ID 1d6b:0002 Linux Foundation 2.0 root hub rock64@rockpro64:/mnt$ lspci 00:00.0 PCI bridge: Rockchip Inc. RK3399 PCI Express Root Port Device 0100 01:00.0 Non-Volatile memory controller: Samsung Electronics Co Ltd NVMe SSD Controller SM961/PM961 rock64@rockpro64:/mnt$Wer was beisteuern kann, immer her damit!

-

schrieb am 2. Juli 2018, 21:08 zuletzt editiert von

Kamil hat heute das USB3 Problem auf dem Mainline-Kernel gefixt. Ab 4.17.0-rc6-1021-ayufan funktioniert USB3 jetzt. Mehr dazu morgen

-

schrieb am 19. Juli 2018, 19:25 zuletzt editiert von

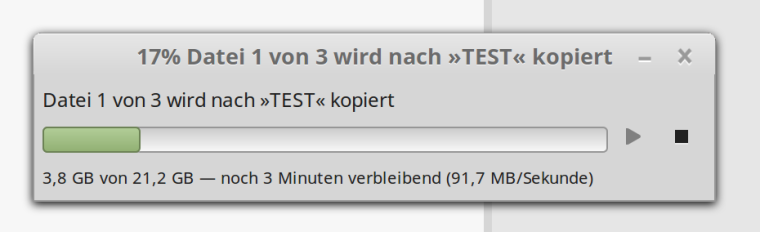

Die Geschwindigkeitsangaben bei LAN unter Bemerkungen sind ermittelt mit einem NFS-Server.

Dabei habe ich auf dem ROCKPro64 einen NFS-Server installiert, die Freigabe lag auf der NVMe-Karte. Danach habe ich drei große Video's auf den ROCKPro64 kopiert. Aus der Erinnerung würde ich sagen, das es auf 4.4 ein wenig stabiler war. Aber ist schon recht flott

-

schrieb am 13. Nov. 2018, 19:07 zuletzt editiert von

SSD an USB3 bootet wenn der u-boot im SPI-Flash ist ^^

https://forum.frank-mankel.org/topic/375/rockpro64-usb3-bootet-von-ssd

-

schrieb am 16. Feb. 2019, 16:59 zuletzt editiert von

Ich sehe gerade, das könnte hier auch mal neu gemacht werden.

-

-

ROCKPro64 - RP64.GPIO

Angeheftet Verschoben Hardware 20. Sept. 2018, 10:21 1

1

-

-

-

-

-

-