Kopia - Verbessertes UI in Arbeit

-

Ich habe mir dann mal eine VM zum Testen aufgesetzt und mal das neue Kopia UI gebaut. Dabei bekam ich einen Fehler, wo ich nicht mit klar kam. Ok, war mal wieder nur eine Kleinigkeit

https://github.com/kopia/kopia/issues/593Hier findet man die Anleitung zum Bauen.

Dann mal schauen, ob die Verbesserungen auch alle gut funktionieren.

-

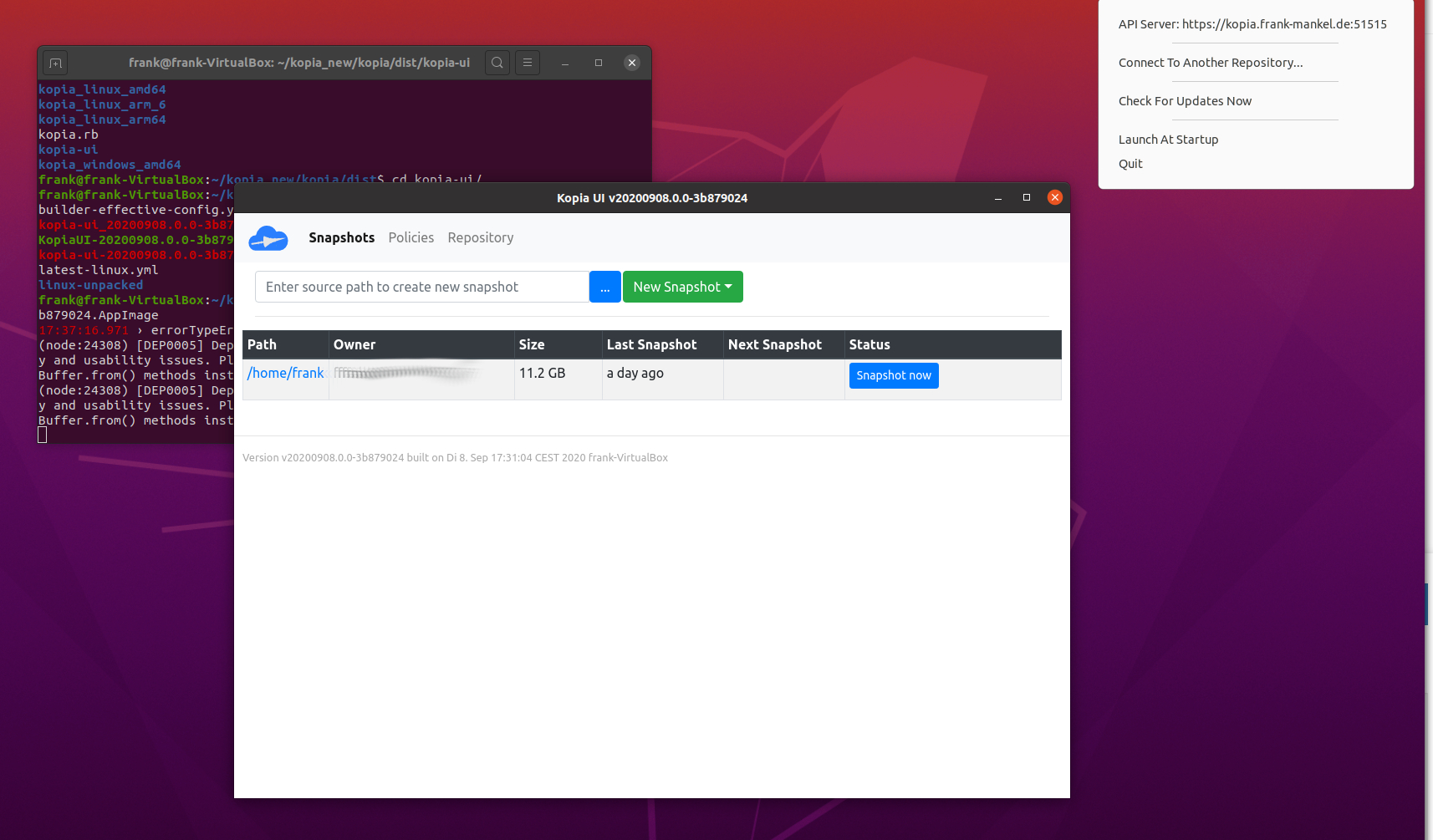

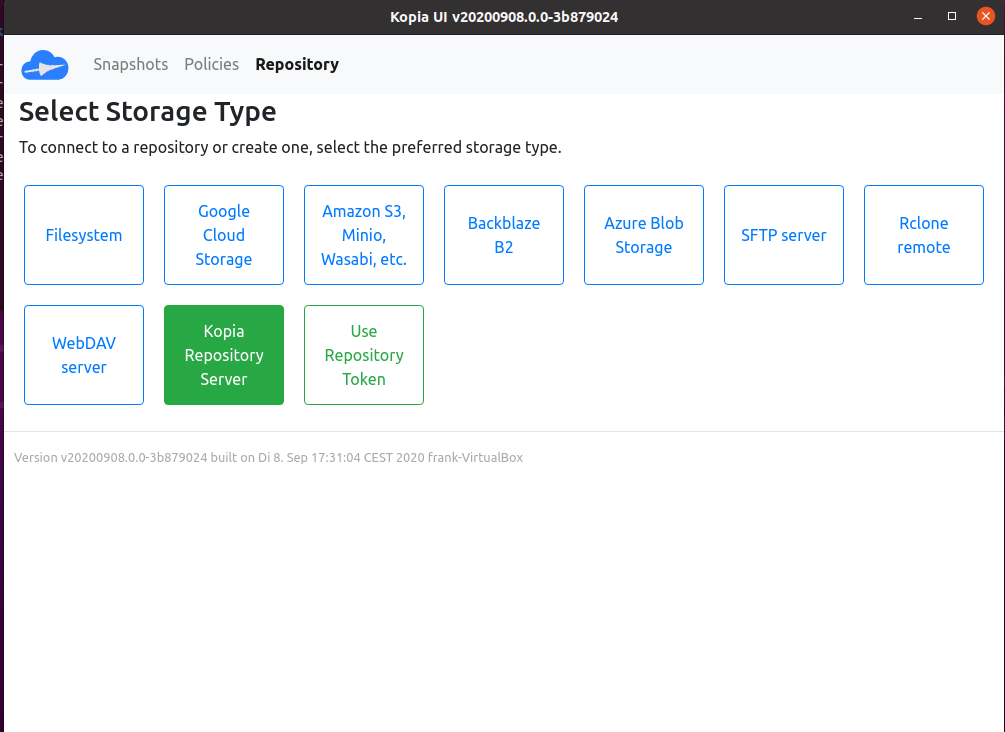

So sieht das UI aus, wenn man keine gespeicherte Verbindung hat.

Da wir uns mit dem Kopia Repository Server beschäftigen, klicken wir da mal drauf.

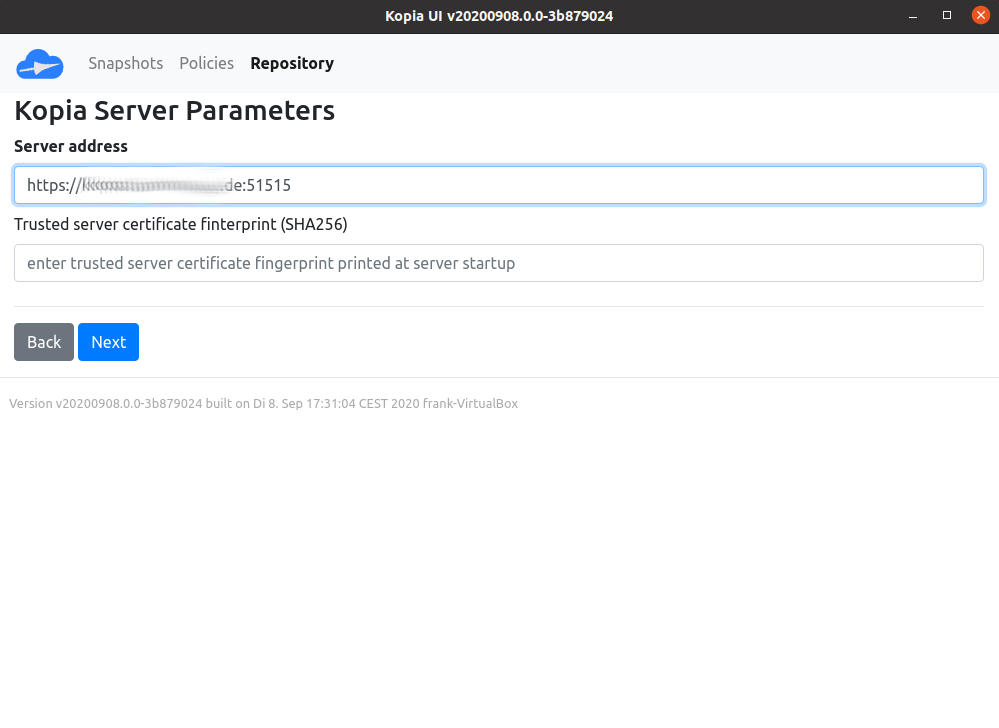

Da geben wir die Server Adresse ein, das Zertifikate Feld brauche ich nicht. Das bleibt leer. Danach kommt folgendes.

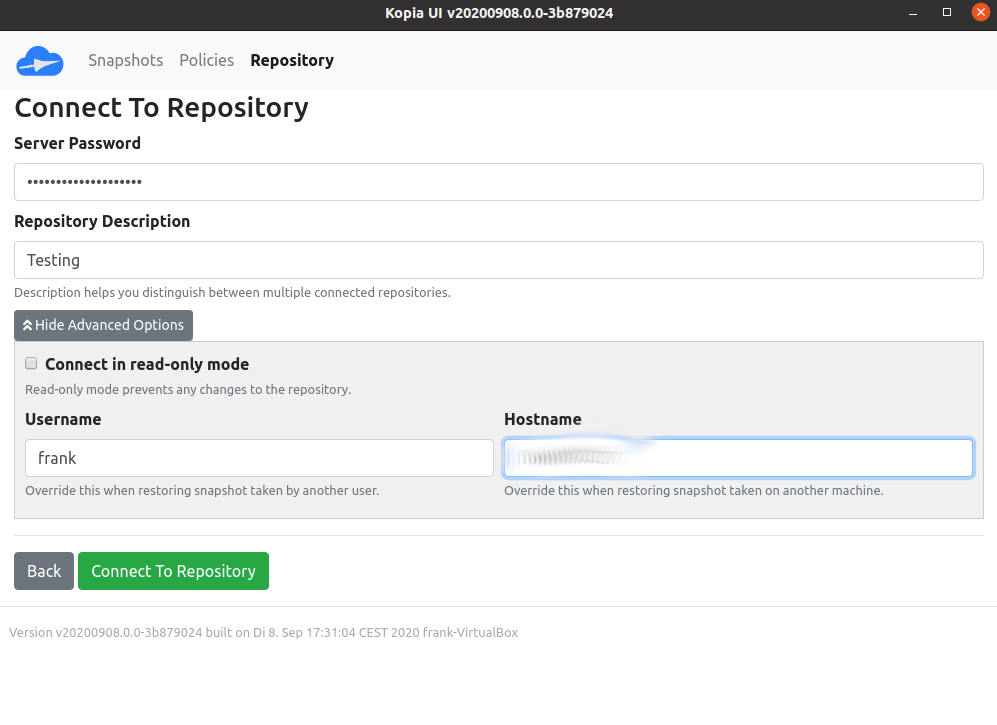

Hier geben wir jetzt das Passwort, einen beliebigen Namen und Username und Hostname ein. Danach verbindet er zum Kopia Server.

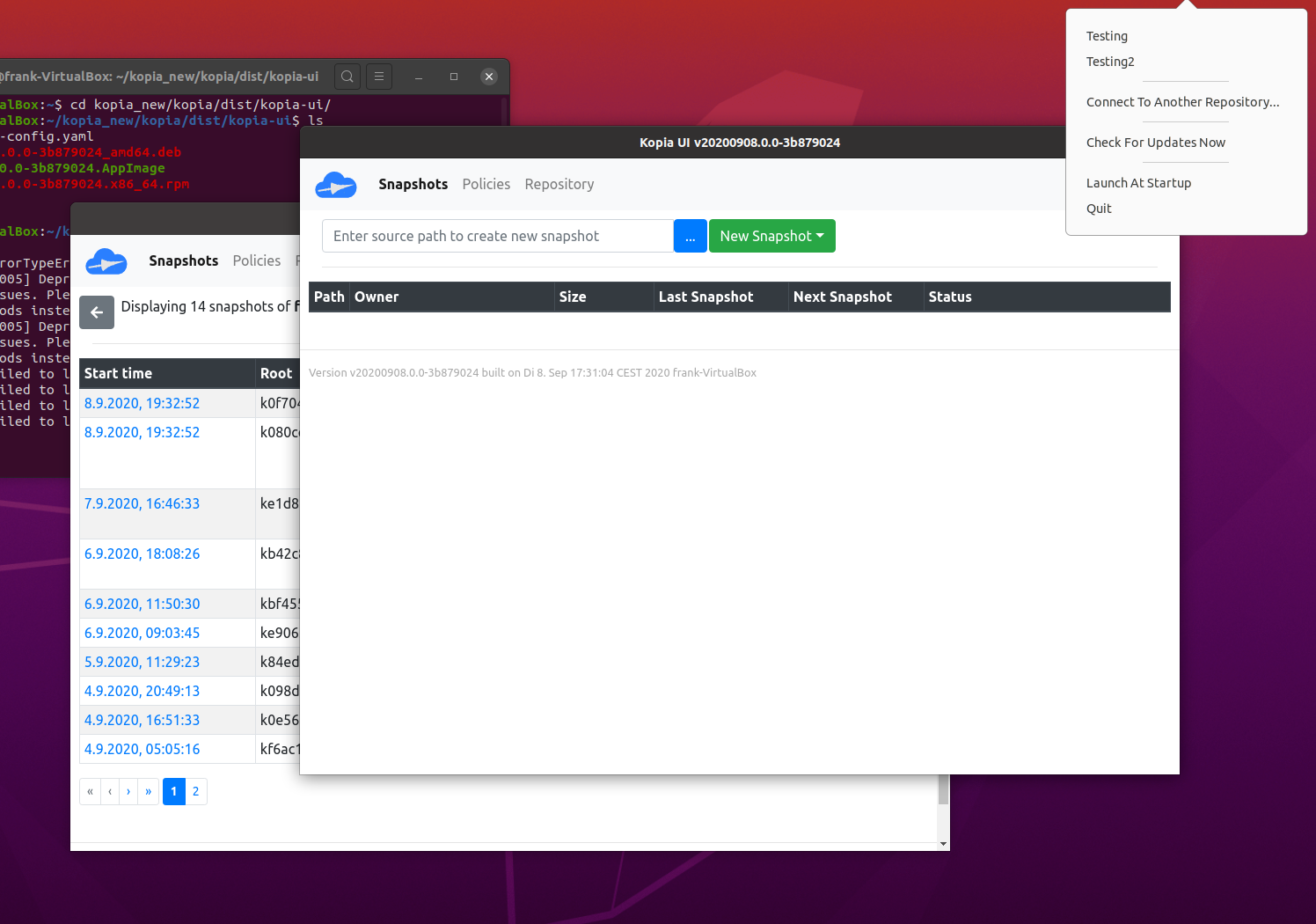

Hier ein Screenshot, von zwei Verbindungen zum Server!

Wenn man die Verbindung nicht mehr braucht, klickt man auf Repository/Disconnect.

Dran denken, die Daten werden gespeichert. Somit ist nach einem Neustart eine sofortige Verbindung zum Server möglich. Erst ein Diconnect löscht die Verbindungsdaten auf dem Rechner!!