ROCKPro64 - Secondary IP entfernen

-

Eben festgestellt, das mein NAS noch mit einem Ubuntu läuft. Damit es hier einheitlich ist, soll das weg

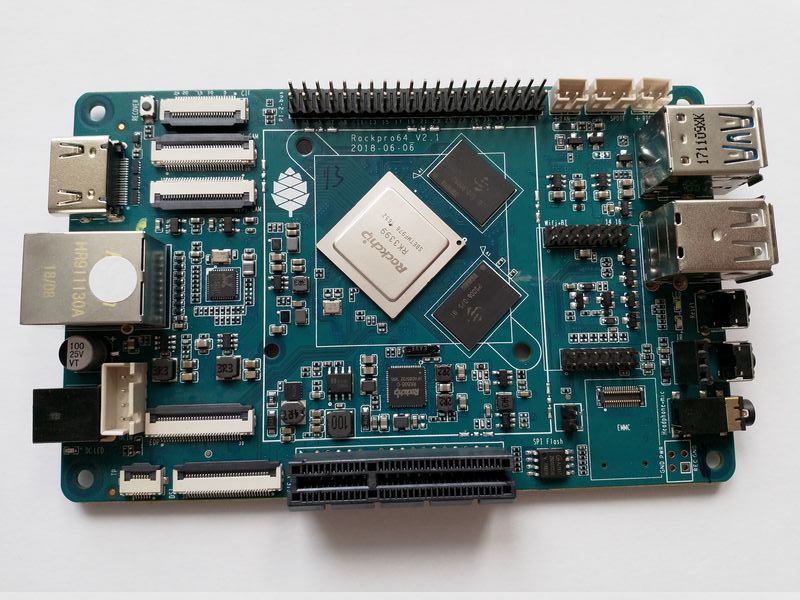

Dafür bin ich gerade ein neues System am Aufsetzen. Dabei ist mir was aufgefallen, auch früher schon, aber diesmal soll das weg!Image

Linux rockpro64 4.4.190-1233-rockchip-ayufan-gd3f1be0ed310 #1 SMP Wed Aug 28 08:59:34 UTC 2019 aarch64Aktualisiert auf Debian Buster 10.1

Problem

rock64@rockpro64:~$ ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UNKNOWN group default qlen 1000 link/ether 62:03:b0:d6:dc:b3 brd ff:ff:ff:ff:ff:ff inet 192.168.3.2/24 brd 192.168.3.255 scope global dynamic eth0 valid_lft 7191sec preferred_lft 7191sec inet 192.168.3.4/24 brd 192.168.3.255 scope global secondary noprefixroute eth0 valid_lft forever preferred_lft forever inet6 2a02:908:1266:9690:xxxxxxxxxxxxxxxxxx/64 scope global dynamic mngtmpaddr noprefixroute valid_lft 7189sec preferred_lft 589sec inet6 fe80::6003:b0ff:fed6:dcb3/64 scope link valid_lft forever preferred_lft foreverIch habe auf der LAN-Schnittstelle zwei IP-Adressen.

inet 192.168.3.2/24 brd 192.168.3.255 scope global dynamic eth0 inet 192.168.3.4/24 brd 192.168.3.255 scope global secondary noprefixroute eth0Die secondary brauch ich nicht. Ok, ein wenig gegoogelt und dann folgendes eingegeben.

systemctl stop dhcpcd systemctl disable dhcpcdDanach neustarten

rebootDann schauen wir mal nach.

rock64@rockpro64:~$ ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UNKNOWN group default qlen 1000 link/ether 62:03:b0:d6:dc:b3 brd ff:ff:ff:ff:ff:ff inet 192.168.3.2/24 brd 192.168.3.255 scope global dynamic eth0 valid_lft 7193sec preferred_lft 7193sec inet6 2a02:908:1266:9690:xxxxxxxxxxxxxxx/64 scope global dynamic mngtmpaddr valid_lft 7198sec preferred_lft 598sec inet6 fe80::6003:b0ff:fed6:dcb3/64 scope link valid_lft forever preferred_lft foreverGut, sie ist weg

Warum das so ist, weiß ich nicht. Für mich macht ein dhcpd da aktuell keinen Sinn!?!? Ich möchte ja keinen Clients Adressen zuteilen. Wenn ich völlig daneben liege, bitte ich um Korrektur.

-

Ich grabe das Thema noch mal aus.

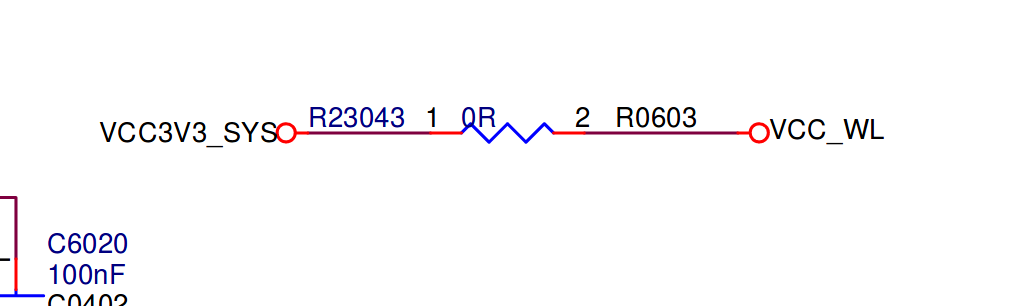

Oben habe ich den Dienst dhcpcd ausgeschaltet. Dieser sorgt dafür, das wir zwei IP-Adressen auf der Schnittstelle haben. Aber, ein kleiner feiner Denkfehler von mir, der Dienst dhcpcd ist nicht gleich Dienst dhcpd !!

dhcpcd

Welcome to the project page for dhcpcd, a DHCP and DHCPv6 client.

Wenn ich diesen Dienst auf folgendem Image abschalte, dann bekomme ich nicht mehr die zweite IP, der ROCKPro64 holt sich aber immer noch per DHCP eine Adresse!?? Welcher Dienst ist dafür verantwortlich??

pstree

Nach dem Abschalten, sieht das so aus.

root@rockpro64:~# pstree systemd-+-NetworkManager---2*[{NetworkManager}] |-2*[agetty] |-alsactl |-avahi-daemon---avahi-daemon |-cron |-dbus-daemon |-dhclient |-dhcpd |-ntpd---{ntpd} |-polkitd---2*[{polkitd}] |-rsyslogd---3*[{rsyslogd}] |-sshd---sshd---sshd---bash---su---bash---pstree |-systemd---(sd-pam) |-systemd-journal |-systemd-logind |-systemd-udevd `-wpa_supplicantHier sieht man das ich einen dhpcd am Laufen habe, der auch artig Adressen verteilt. Hmm, was ich immer noch nicht verstehe, wer macht denn jetzt den DHCP für den Client? Networkmanager? systemd?

Wird fortgesetzt....

-

Hallo Frank,

also ich hatte auf meiner installation dhcpcd5 mit apt remove --purge dhcpcd5 deinstalliert und in /etc/network/interfaces.d/eth0 die statische Konfiguration zugefügt.

Evtl. kann es auch noch zusätzlich sein das der dhcpcd durch einen upgrade wieder aktiviert wurde, habe ich halt auch schon mal gesehen.

Den dhcpd brauchst du vermutlich auch nicht, wenn du nicht neben deinem router IPs verteilen möchtest.

Evtl. hast du auch noch das Paket isc-dhcp-client installiert, aber das stört üblicherweise nicht da es der dhclient dort nicht als daemon läuft.

Gruß

Martin -

Hallo @mabs,

es ging bei meinem Post gar nicht um den dhcpd, also den Daemon der die Adressen verteilt. Hintergrund, ich versuche gerade mal wieder einen Router auf Basis eines ROCKPro64 zu bauen. Dabei bin ich in Kamils Debian Minimal über die zweite IP-Adresse gestolpert.

Danke aber für deine Anregungen.

Es gibt da aber wohl mit dem Debian Minimal irgendwelche Probleme mit dem Forwarding, so das ich das jetzt auf einem Bionic mache, dort klappt das einwandfrei. Aber dazu später ausführlich in einem anderen Thread.