@RaSc sagte in Proxmox - Umzug auf neue Hardware ASRock N100DC-ITX:

Nun habe ich mich etwas in Proxmox und ZFS eingelesen. Das soll große Schreiblasten verursachen und die SSD ordentlich stressen bzw. kaputschreiben.

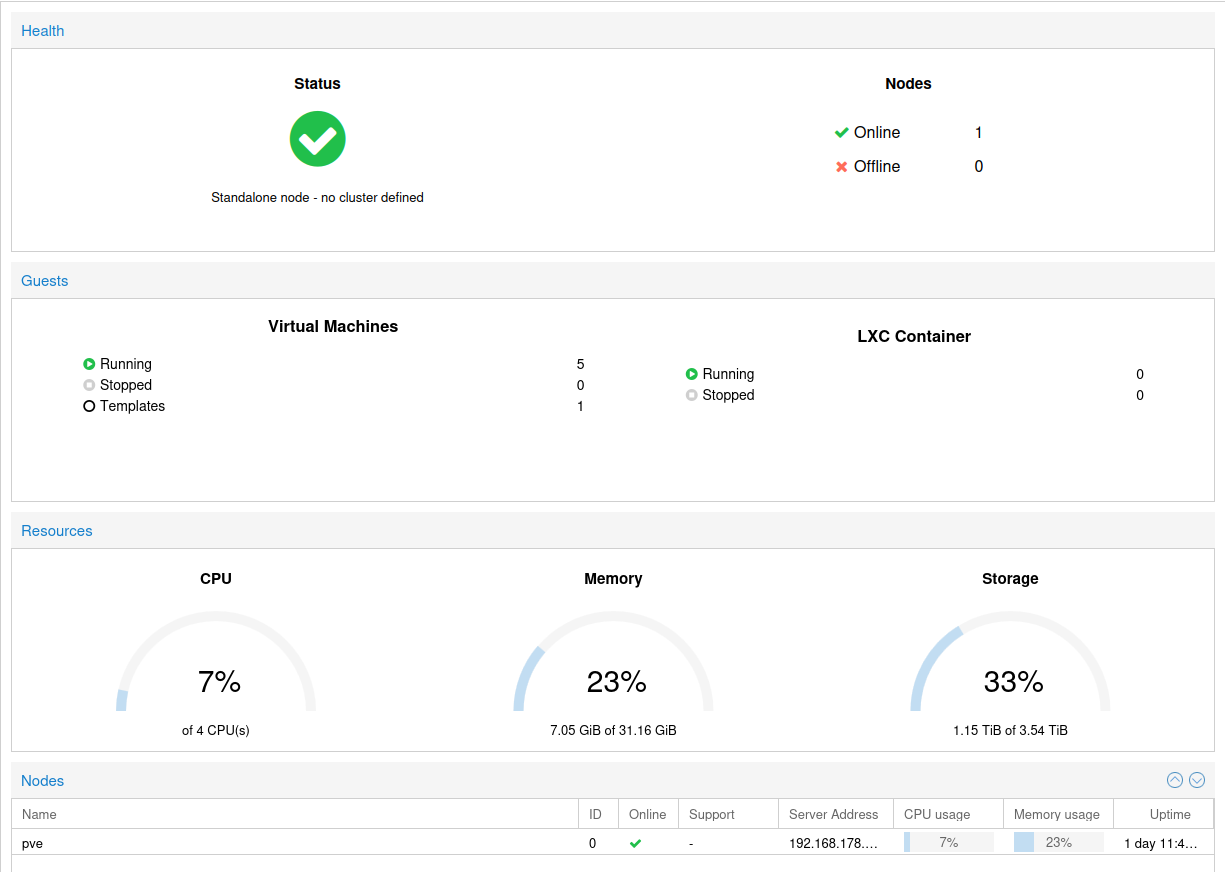

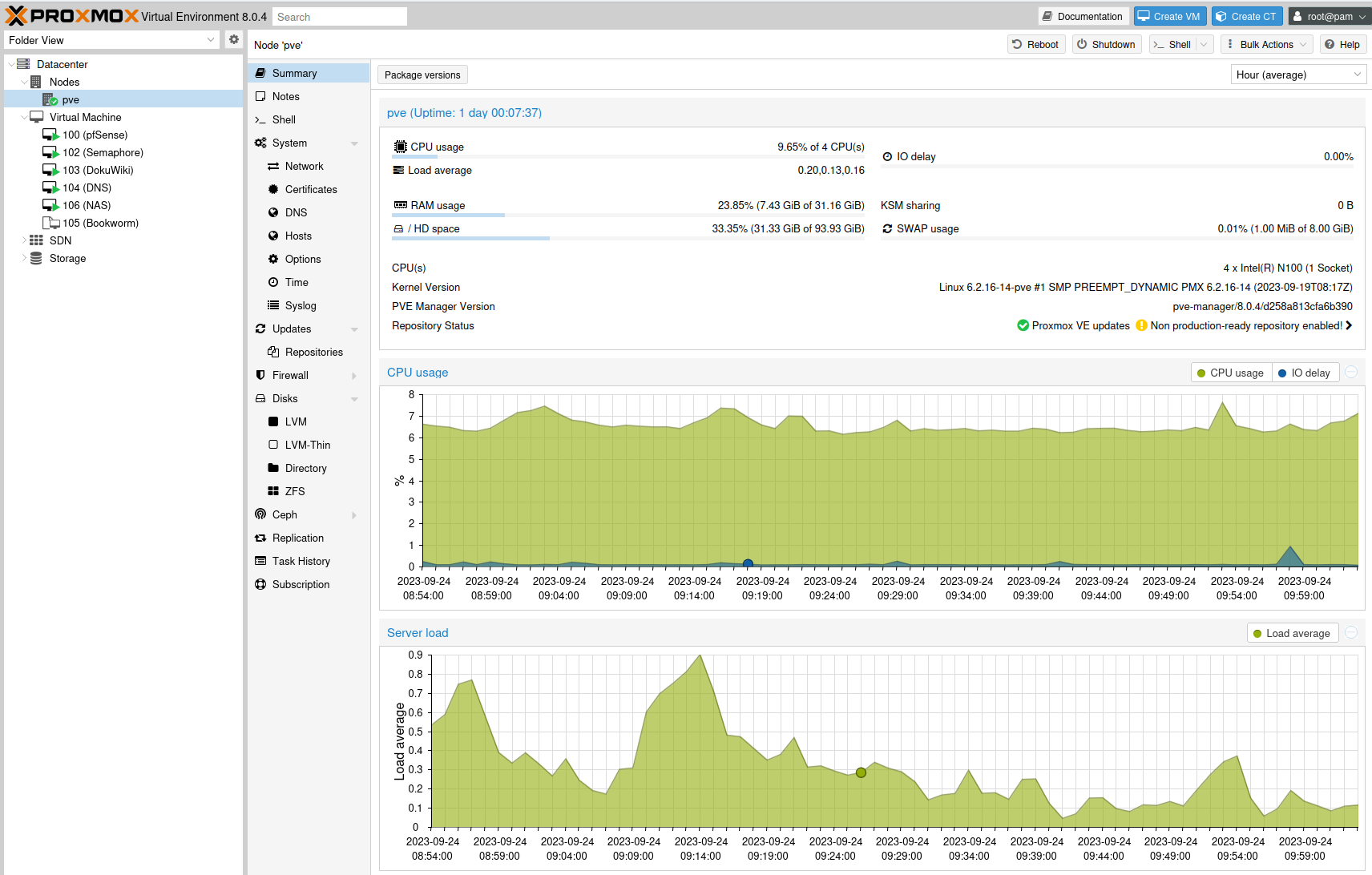

Hallo @RaSc und Willkommen im Forum. Ja, das kann passieren, vor allen Dingen im Zusammenhang mit dem Proxmox Backup Server. Das ist aber für mein Setup unerheblich, warum? Eine Erklärung.

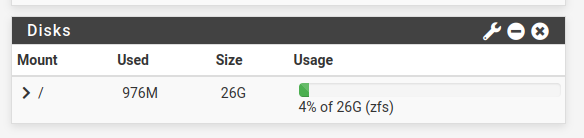

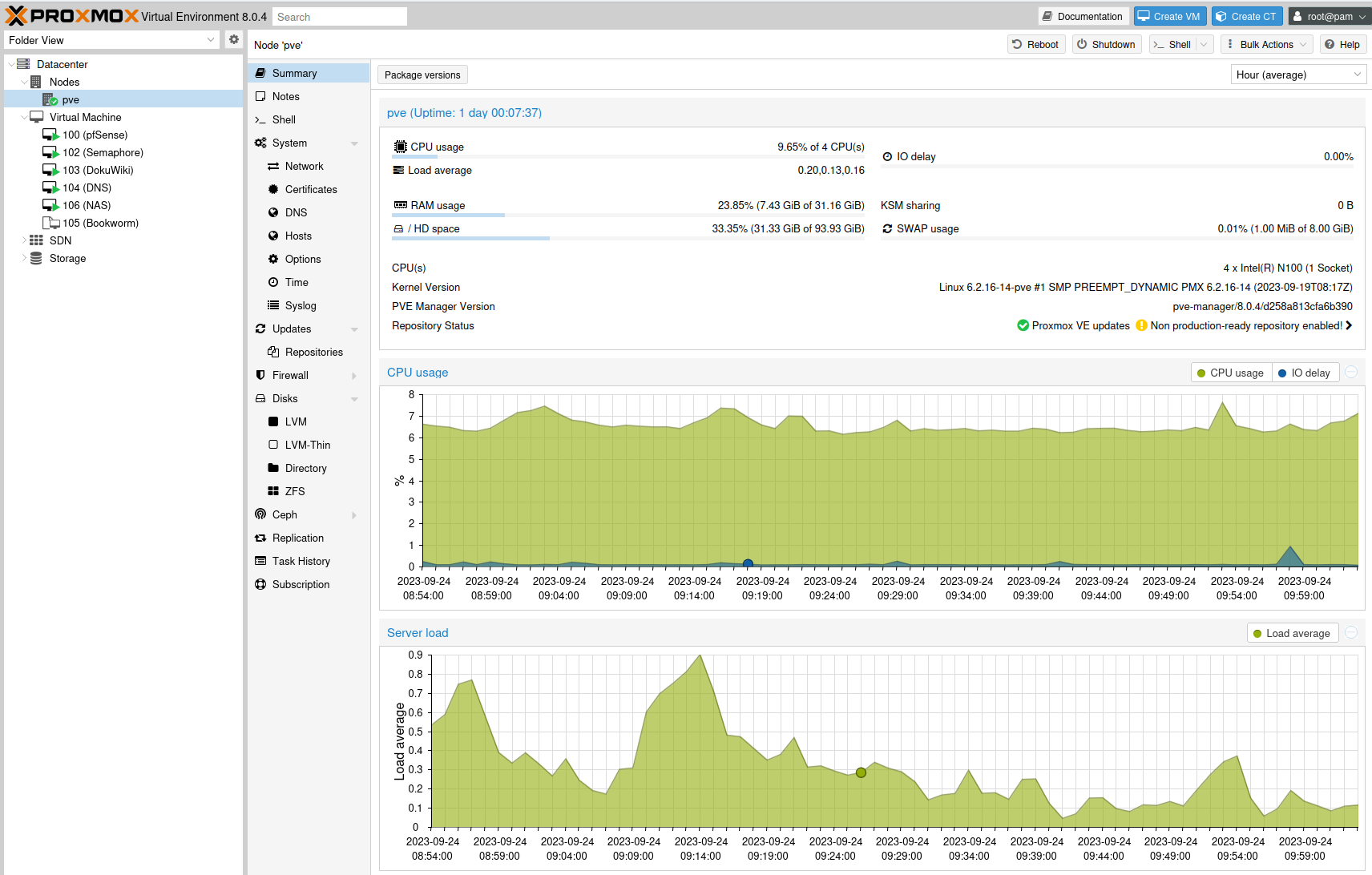

Mein Proxmox Setup basiert auf einer verbauten NVMe SSD. Soll heißen, der Proxmox Host läuft auf dieser NVMe und beinhaltet ein normales ext4.

/dev/mapper/pve-root: UUID="0aad6271-9162-479a-a724-cde690acfb10" BLOCK_SIZE="4096" TYPE="ext4"

Ok, alles gut. Läuft also wie immer. Warum jetzt ZFS im Proxmox? Proxmox bietet über sein GUI nur eine Raid Installation mittels ZFS an. So weit ich weiß, bietet man auch nur dafür Support an.

Man könnte das auch noch über die Konsole machen, Stichwort mdadm, aber ich erinnere mich das das nicht so wollte wie es sollte. So habe ich am Ende doch zu ZFS gegriffen.

Noch ein kurzes Beispiel, wer noch so alles zu ZFS greift. pfSense nutzt das mittlerweile auch.

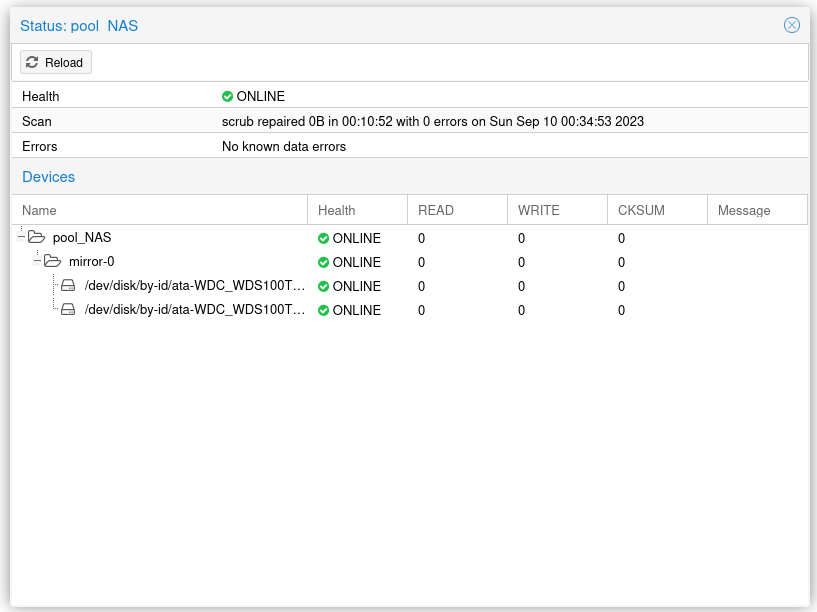

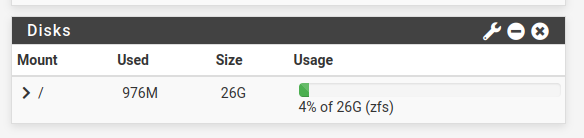

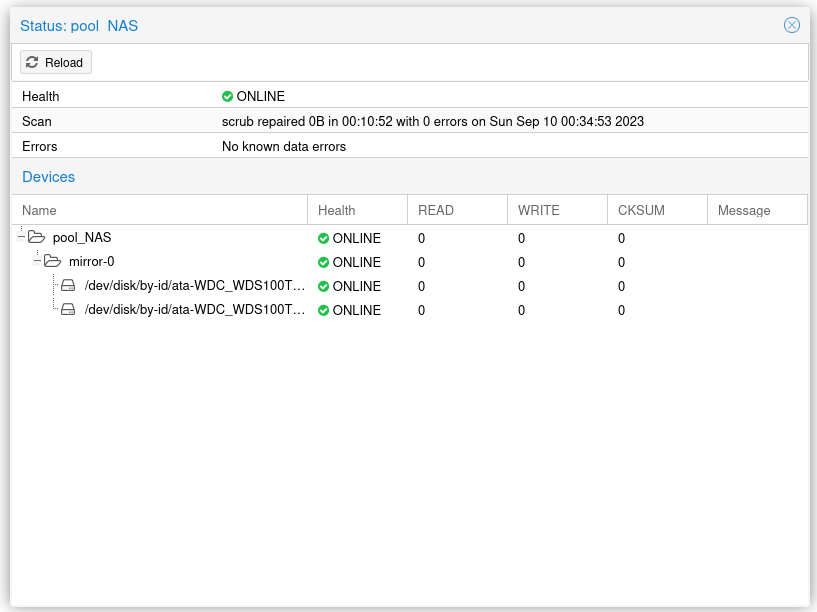

Zurück zu meinem NAS. Jetzt habe ich zwei SSD-Platten WD Red an den SATA-Ports angeschlossen. Diese beiden SSDs sind zu einem Raid 1 (ZFS) zusammengefasst.

Da passiert erst mal gar nichts, weil was soll da groß drauf schreiben? Ist nur meine persönliche Datenablage.

Was bei ZFS sehr wichtig ist, ist genug RAM. Da ZFS sehr viel RAM für die Verwaltung benötigt. (Bin da kein Experte für)

Aber auch das sehe ich ganz entspannt.

Es laufen aktuell 5 Debian Bookworm 12 VMs.

Was wichtig ist, aber das ist es immer, Backups! Die lege ich auf eine angeschlossene 2,5 Zoll HDD ab. Da kommen die Backups der VMs und mein Restic Backup des NAS drauf.

Ich fühle mich damit eigentlich ganz wohl