Wir können das noch für eine sanfte Methode erweitern, das ist die Datei robots.txt, wo man sich in alten Zeiten mal dran hielt. Einige Bots machen das, andere nicht. Praktisch, das o.g. Projekt bietet diese Datei auch an. Dann werden wir das kurz mal mit einbauen.

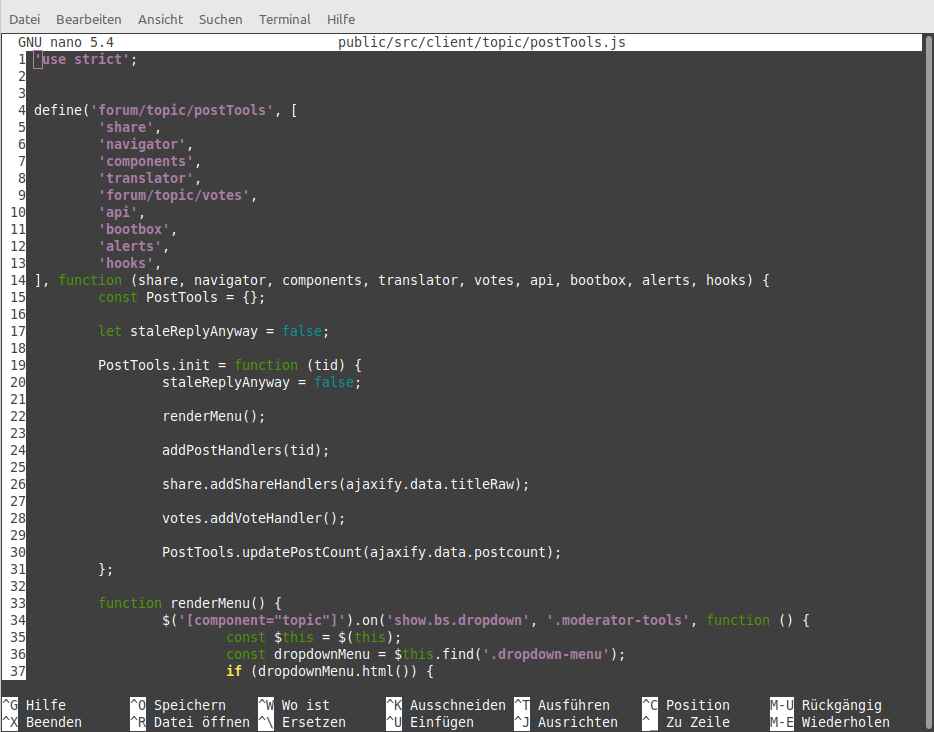

ai-block.sh

#!/bin/bash

# Script um AI-Bots zu blocken

# https://github.com/ai-robots-txt/ai.robots.txt/tree/main

mkdir /root/AI-test

cd /root/AI-test

## Daten holen

curl -O https://raw.githubusercontent.com/ai-robots-txt/ai.robots.txt/master/nginx-block-ai-bots.conf

curl -O https://raw.githubusercontent.com/ai-robots-txt/ai.robots.txt/master/robots.txt

## Daten in nginx einbauen

mv nginx-block-ai-bots.conf /etc/nginx/blocklists/

mv robots.txt /var/www/html

## NGINX neustarten

systemctl restart nginx.service

Damit das in nginx funktioniert. Den Server Block um folgendes erweitern.

# Serve robots.txt directly from Nginx

location = /robots.txt {

root /var/www/html;

try_files $uri =404;

}

Kurzer Test

https://<DOMAIN>/robots.txt

Ergebnis

User-agent: AI2Bot

User-agent: Ai2Bot-Dolma

User-agent: Amazonbot

User-agent: anthropic-ai

User-agent: Applebot

User-agent: Applebot-Extended

User-agent: Brightbot 1.0

User-agent: Bytespider

User-agent: CCBot

User-agent: ChatGPT-User

User-agent: Claude-Web

User-agent: ClaudeBot

User-agent: cohere-ai

User-agent: cohere-training-data-crawler

User-agent: Crawlspace

User-agent: Diffbot

User-agent: DuckAssistBot

User-agent: FacebookBot

User-agent: FriendlyCrawler

User-agent: Google-Extended

User-agent: GoogleOther

User-agent: GoogleOther-Image

User-agent: GoogleOther-Video

User-agent: GPTBot

User-agent: iaskspider/2.0

User-agent: ICC-Crawler

User-agent: ImagesiftBot

User-agent: img2dataset

User-agent: imgproxy

User-agent: ISSCyberRiskCrawler

User-agent: Kangaroo Bot

User-agent: Meta-ExternalAgent

User-agent: Meta-ExternalFetcher

User-agent: OAI-SearchBot

User-agent: omgili

User-agent: omgilibot

User-agent: PanguBot

User-agent: Perplexity-User

User-agent: PerplexityBot

User-agent: PetalBot

User-agent: Scrapy

User-agent: SemrushBot-OCOB

User-agent: SemrushBot-SWA

User-agent: Sidetrade indexer bot

User-agent: Timpibot

User-agent: VelenPublicWebCrawler

User-agent: Webzio-Extended

User-agent: YouBot

Disallow: /