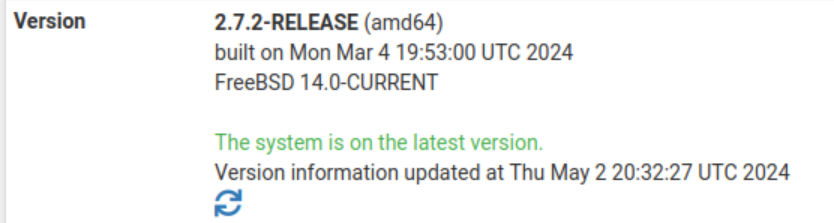

pfSense - Release 2.7.2

pfSense

1

Beiträge

1

Kommentatoren

366

Aufrufe

-

Ich habe meine pfSense doch ein wenig vernachlässigt. Sie war doch noch auf v2.7.0 und wollte sich nicht upgraden lassen. Was machen?

Dank der tollen Anleitung ließ sich das Problem fixen.

pkg-static update -fführte zu einer Reihe von Fehlern.

An error occured while fetching packageIn der Anleitung steht

Try running certctl rehash from the console, a root shell prompt, or via Diagnostics > Command Prompt. This will allow pkg to utilize the system certificates until the next reboot.

Also

certctl rehashin die Konsole und er macht irgendwas. Nehme an, er hat die Zertifikate überprüft!? Danach ließ sich die pfSense aktualisieren. Jetzt ist sie wieder auf der letzten Version.

Übrigens, die Release Notes findet ihr hier

-

-

-

-

-

-

-

-

Ubuntu Bionic - IP Adresse ändern

Angeheftet Verschoben Linux