zram - Was das??

-

Wenn man auf einer minimal Bionic Installation ein

fdisk -lmacht, bekommt man folgende Ausgabe.

Disk /dev/ram0: 4 MiB, 4194304 bytes, 8192 sectors Units: sectors of 1 * 512 = 512 bytes Sector size (logical/physical): 512 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/mmcblk0: 14.7 GiB, 15811477504 bytes, 30881792 sectors Units: sectors of 1 * 512 = 512 bytes Sector size (logical/physical): 512 bytes / 512 bytes I/O size (minimum/optimal): 512 bytes / 512 bytes Disklabel type: gpt Disk identifier: E55EA076-C740-42B9-A619-20BF1A4DE0E1 Device Start End Sectors Size Type /dev/mmcblk0p1 64 8063 8000 3.9M Linux filesystem /dev/mmcblk0p2 8064 8191 128 64K Linux filesystem /dev/mmcblk0p3 8192 16383 8192 4M Linux filesystem /dev/mmcblk0p4 16384 24575 8192 4M Linux filesystem /dev/mmcblk0p5 24576 32767 8192 4M Linux filesystem /dev/mmcblk0p6 32768 262143 229376 112M Microsoft basic data /dev/mmcblk0p7 262144 30881758 30619615 14.6G Linux filesystem Disk /dev/zram0: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram1: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram2: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram3: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram4: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram5: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytesDa stoße ich mal wieder auf was, was ich nicht kenne. zram Ok, schauen wir mal was das ist und was das macht.

Gerade auf Systemen mit wenig Arbeitsspeicher kommt es hin und wieder vor, dass dieser knapp wird und das System beginnt, den Swap-Speicher zu nutzen. Da sich dieser auf der Festplatte befindet, ist er im Vergleich zum RAM relativ langsam.

Gut, damit hätten wir das hier geklärt.

swapon -sgibt folgendes aus

Filename Type Size Used Priority /dev/zram0 partition 330760 0 5 /dev/zram1 partition 330760 0 5 /dev/zram2 partition 330760 0 5 /dev/zram3 partition 330760 0 5 /dev/zram4 partition 330760 0 5 /dev/zram5 partition 330760 0 5Ein

freegibt folgendes aus

total used free shared buff/cache available Mem: 3969156 75080 3779900 8512 114176 3855688 Swap: 1984560 0 1984560Wenn man die 330760 mit 6 multipliziert, kommt man auf 1984560.

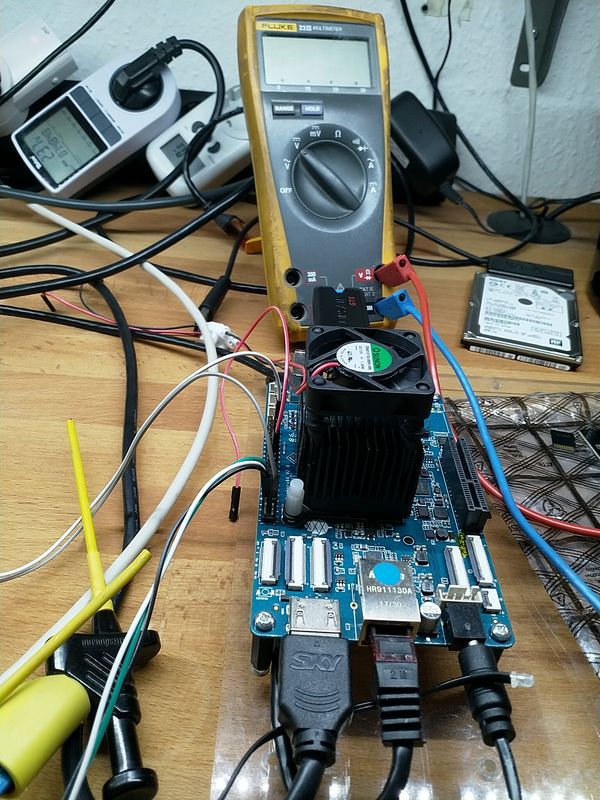

So wie ich das verstehe, legt diese Installation 1,98 GB RAM als SWAP-Partition im schnelleren RAM ab. Macht ja auch Sinn, bei den lahmen SD-Karten. Anmerkung: Ich habe den ROCKPro64 mit 4 GB RAM.

-

Wenn man auf einer minimal Bionic Installation ein

fdisk -lmacht, bekommt man folgende Ausgabe.

Disk /dev/ram0: 4 MiB, 4194304 bytes, 8192 sectors Units: sectors of 1 * 512 = 512 bytes Sector size (logical/physical): 512 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/mmcblk0: 14.7 GiB, 15811477504 bytes, 30881792 sectors Units: sectors of 1 * 512 = 512 bytes Sector size (logical/physical): 512 bytes / 512 bytes I/O size (minimum/optimal): 512 bytes / 512 bytes Disklabel type: gpt Disk identifier: E55EA076-C740-42B9-A619-20BF1A4DE0E1 Device Start End Sectors Size Type /dev/mmcblk0p1 64 8063 8000 3.9M Linux filesystem /dev/mmcblk0p2 8064 8191 128 64K Linux filesystem /dev/mmcblk0p3 8192 16383 8192 4M Linux filesystem /dev/mmcblk0p4 16384 24575 8192 4M Linux filesystem /dev/mmcblk0p5 24576 32767 8192 4M Linux filesystem /dev/mmcblk0p6 32768 262143 229376 112M Microsoft basic data /dev/mmcblk0p7 262144 30881758 30619615 14.6G Linux filesystem Disk /dev/zram0: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram1: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram2: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram3: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram4: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytes Disk /dev/zram5: 323 MiB, 338702336 bytes, 82691 sectors Units: sectors of 1 * 4096 = 4096 bytes Sector size (logical/physical): 4096 bytes / 4096 bytes I/O size (minimum/optimal): 4096 bytes / 4096 bytesDa stoße ich mal wieder auf was, was ich nicht kenne. zram Ok, schauen wir mal was das ist und was das macht.

Gerade auf Systemen mit wenig Arbeitsspeicher kommt es hin und wieder vor, dass dieser knapp wird und das System beginnt, den Swap-Speicher zu nutzen. Da sich dieser auf der Festplatte befindet, ist er im Vergleich zum RAM relativ langsam.

Gut, damit hätten wir das hier geklärt.

swapon -sgibt folgendes aus

Filename Type Size Used Priority /dev/zram0 partition 330760 0 5 /dev/zram1 partition 330760 0 5 /dev/zram2 partition 330760 0 5 /dev/zram3 partition 330760 0 5 /dev/zram4 partition 330760 0 5 /dev/zram5 partition 330760 0 5Ein

freegibt folgendes aus

total used free shared buff/cache available Mem: 3969156 75080 3779900 8512 114176 3855688 Swap: 1984560 0 1984560Wenn man die 330760 mit 6 multipliziert, kommt man auf 1984560.

So wie ich das verstehe, legt diese Installation 1,98 GB RAM als SWAP-Partition im schnelleren RAM ab. Macht ja auch Sinn, bei den lahmen SD-Karten. Anmerkung: Ich habe den ROCKPro64 mit 4 GB RAM.

@frankm Ubuntu legt seit Version 13.04 (oder so) per default zram als Swap an (bzw. muß man nur das zram-control Package installieren). Größe ist die Hälfte des verfügbaren RAMs und außerdem werden pro CPU-Core ein zram Block-Device angelegt (braucht's mit halbwegs modernen Kerneln nicht).

Ich versuch, das schon seit geraumer Zeit in Armbian zu verbessern (zram momentan nur in den Ubuntu-Varianten aktiv) aber das geht alles recht zäh. Ein paar Hintergrundinfos (und Info, wie man das noch optimieren kann) wie so oft bei CNX-Soft: https://www.cnx-software.com/2018/05/14/running-out-of-ram-in-ubuntu-enable-zram/ (in den Kommentaren auch gucken).

-

ROCKPro64 - Debian Bullseye Teil 2

Verschoben ROCKPro64 -

-

-

-

-

-

-