ClusterSSH

-

Beim Lesen der Beiträge im Debian Forum, bin ich doch über einen tollen Tipp gestolpert.

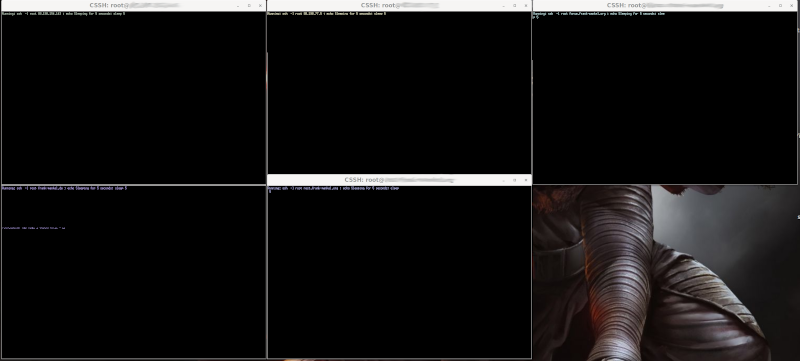

ClusterSSH

The command opens an administration console and an xterm to all

specified hosts. Any text typed into the administration console is

replicated to all windows. All windows may also be typed into directly.Installation

sudo apt install clustersshAufruf

cssh root@<IPv4> root@<IPv4>Das öffnet zwei Terminals.

Wenn ich nun alle meine Server auf einen Schlag öffnen möchte, um z.B. Updates zu installieren? Wechseln in das folgende Verzeichnis.

cd ~/.clustersshDatei clusters anlegen.

cluster root@<IPv4> root@<IPv4> root@<IPv4> root@<IPv4> root@<IPv4>Nun würde der Aufruf

cssh cluster

alle fünf Terminals auf einen Schlag öffnen. Und über das Kontrollfenster kann man z.B. ein

apt update && apt upgradean alle 5 Server gleichzeitig eingeben. Man kann auf jedem Server eingreifen. Super praktisch!

In der config habe ich noch folgendes eingestellt.

rows=2 terminal_size=160x48

-

Ich hatte irgendwo geschrieben, das ClusterSSH nicht auf Wayland funktioniert!? Das ist Quatsch.

Auf Ubuntu 21.04 mit Wayland lüuft ClusterSSH einwandfrei. Ich habe lediglich die Fenstergröße etwas angepasst, man sieht ja nicht mehr so gut

terminal_size=160x48 -

F FrankM hat am auf dieses Thema verwiesen

F FrankM hat am auf dieses Thema verwiesen

-

F FrankM hat am auf dieses Thema verwiesen

F FrankM hat am auf dieses Thema verwiesen

-

Mal wieder lange dran rumgefummelt, bis es passte.

I have figured out how to use any font in xterm. So for the case of the mentioned Inconsolata font size 14, the following works:

- Add these 2 lines into ~/.Xresources (create it if it does not exist)

XTermfaceName: Inconsolata

XTermfaceSize: 14- Then, tell xterm to use this file:

export XENVIRONMENT="${HOME}/.Xresources"

Preferably add this export into .bashrc, so that it is persistent.

- comment out the font settings in ~/.clusterssh/config, if it exists:

# terminal_font=6x13

Quelle: https://unix.stackexchange.com/questions/230106/cluster-ssh-specify-terminal-font

-

F FrankM hat am auf dieses Thema verwiesen

F FrankM hat am auf dieses Thema verwiesen