Nachdem ich die Tage feststellen musste, das irgendwas mit dem Gerät nicht stimmte, bekam keine DNS Auflösung über die Konsole, habe ich das heute mal eben neuinstalliert.

Armbian ist ja immer was spezielles Hat sich bis heute nix dran geändert.....

Ok, dann heute mal eben ein neues Image erstellt. Download Gewählt habe ich das Armbian Buster.

Image auf die SD-Karte, eingeloggt. Alles wie oben erstellt und abgespeichert. Neustart, geht wieder alles.

root@192.168.3.15's password:

_ _ _ ____ ____ ____

| \ | | __ _ _ __ ___ _ __ (_) | _ \|___ \/ ___|

| \| |/ _` | '_ \ / _ \| '_ \| | | |_) | __) \___ \

| |\ | (_| | | | | (_) | |_) | | | _ < / __/ ___) |

|_| \_|\__,_|_| |_|\___/| .__/|_| |_| \_\_____|____/

|_|

Welcome to Debian GNU/Linux 10 (buster) with Linux 5.9.11-rockchip64

System load: 2% Up time: 11 min

Memory usage: 10% of 978M IP: 192.168.3.15 192.168.1.1 192.168.2.1

CPU temp: 61°C Usage of /: 5% of 29G

Last login: Sun Dec 6 12:28:10 2020 from 192.168.3.213

Kernelversion

root@nanopi-r2s:~# uname -a

Linux nanopi-r2s 5.9.11-rockchip64 #20.11.1 SMP PREEMPT Fri Nov 27 21:59:08 CET 2020 aarch64 GNU/Linux

ip a

oot@nanopi-r2s:~# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP group default qlen 1000

link/ether b2:b5:10:38:9e:76 brd ff:ff:ff:ff:ff:ff

inet 192.168.3.15/24 brd 192.168.3.255 scope global dynamic eth0

valid_lft 6360sec preferred_lft 6360sec

inet6 2a02:908:xxxxxx/64 scope global dynamic mngtmpaddr

valid_lft 7196sec preferred_lft 596sec

inet6 fe80::b0b5:10ff:fe38:9e76/64 scope link

valid_lft forever preferred_lft forever

3: lan0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether b2:b5:10:38:9e:96 brd ff:ff:ff:ff:ff:ff

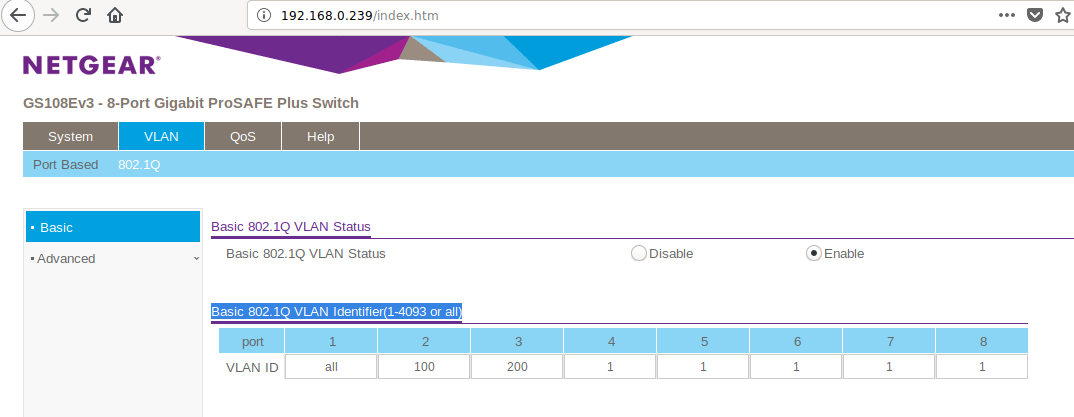

4: lan0.100@lan0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000

link/ether b2:b5:10:38:9e:96 brd ff:ff:ff:ff:ff:ff

inet 192.168.1.1/24 brd 192.168.1.255 scope global lan0.100

valid_lft forever preferred_lft forever

inet6 fe80::b0b5:10ff:fe38:9e96/64 scope link

valid_lft forever preferred_lft forever

5: lan0.200@lan0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000

link/ether b2:b5:10:38:9e:96 brd ff:ff:ff:ff:ff:ff

inet 192.168.2.1/24 brd 192.168.2.255 scope global lan0.200

valid_lft forever preferred_lft forever

inet6 fe80::b0b5:10ff:fe38:9e96/64 scope link

valid_lft forever preferred_lft forever

Vom Notebook aus funktioniert auch alles. So weit bin ich zufrieden. Jetzt mal langsam anfangen, der Kiste IPv6 beizubringen. Oje, nicht gerade mein Lieblingsthema...

Bis der NanoPi R4S hier ankommt und ein vernünftiges Image hat, vergeht ja noch was Zeit...