Benchmark Script

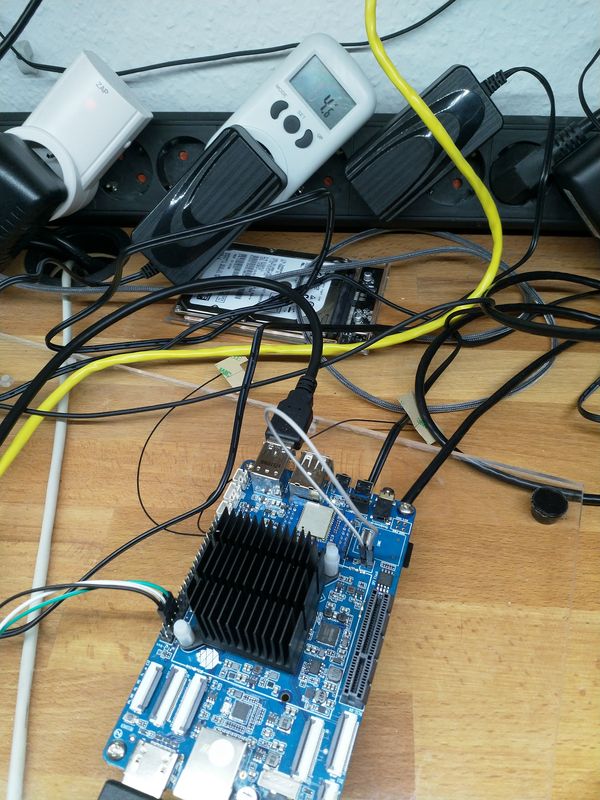

ROCKPro64

2

Beiträge

1

Kommentatoren

681

Aufrufe

-

@tkaiser hat ein Script zur Verfügung gestellt um verschiedene Boards zu testen. Es funktioniert auch auf einem ROCKPro64

Quelle: https://forum.armbian.com/topic/7763-benchmarking-cpus/?do=findComment&comment=58905

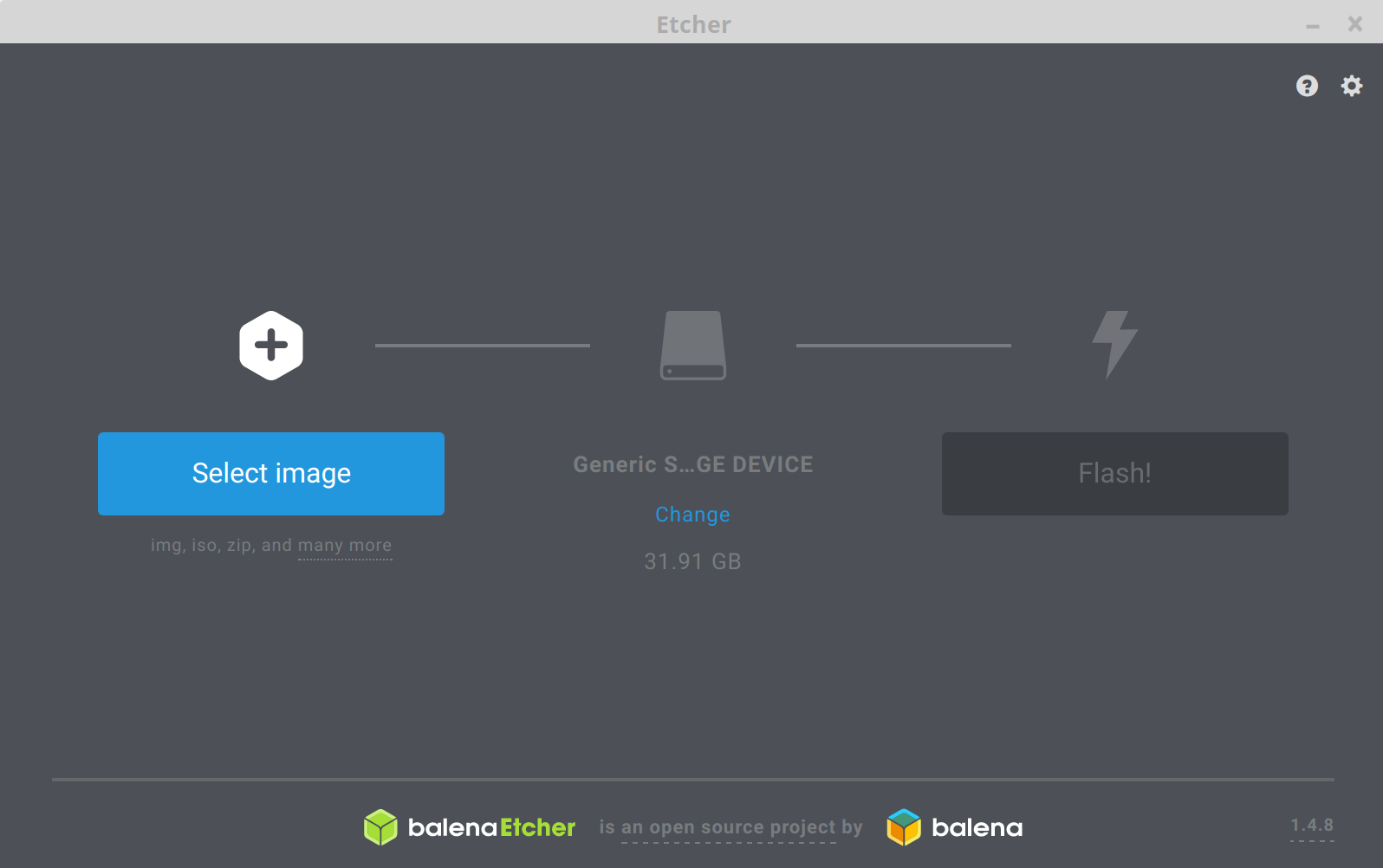

sudo wget -O /usr/local/bin/sbc-bench.sh https://raw.githubusercontent.com/ThomasKaiser/sbc-bench/master/sbc-bench.sh sudo chmod 755 /usr/local/bin/sbc-bench.sh sudo /usr/local/bin/sbc-bench.shMein gekürztes Ergebnis auf einem ROCKPro64 v2.1 mit 2GB RAM und 4.4er Kernel, dieser ROCK benutzt eine 32GB eMMC Karte!

Distributor ID: Ubuntu Description: Ubuntu 18.04.1 LTS Release: 18.04 Codename: bionic Architecture: arm64 Uptime: 14:16:44 up 18:24, 1 user, load average: 0.00, 0.00, 0.00 Linux 4.4.132-1075-rockchip-ayufan-ga83beded8524 (rockpro64v2_1) 07/27/18 _aarch64_ (6 CPU) avg-cpu: %user %nice %system %iowait %steal %idle 0.04 0.00 0.02 0.01 0.00 99.93 Device tps kB_read/s kB_wrtn/s kB_read kB_wrtn mmcblk1 1.23 3.16 6.52 209427 432016 mmcblk1boot1 0.00 0.00 0.00 216 0 mmcblk1boot0 0.00 0.00 0.00 216 0 sda 0.00 0.06 0.00 4236 0 zram0 0.00 0.02 0.00 1192 4 zram1 0.00 0.02 0.00 1192 4 zram2 0.00 0.02 0.00 1192 4 zram3 0.00 0.02 0.00 1192 4 zram4 0.00 0.02 0.00 1192 4 zram5 0.00 0.02 0.00 1192 4 total used free shared buff/cache available Mem: 1.9G 76M 1.6G 3.5M 262M 1.8G Swap: 995M 0B 995M Filename Type Size Used Priority /dev/zram0 partition 169908 0 5 /dev/zram1 partition 169908 0 5 /dev/zram2 partition 169908 0 5 /dev/zram3 partition 169908 0 5 /dev/zram4 partition 169908 0 5 /dev/zram5 partition 169908 0 5 ##########################################################################Das komplette Ergebnis http://ix.io/1iwu

Danke @tkaiser

-

Mainline

Mein gekürztes Ergebnis auf einem ROCKPro64 v2.0 mit 4GB RAM und 4.18er Kernel, dieser ROCK benutzt eine SD-Karte!

Gekürzt

Distributor ID: Ubuntu Description: Ubuntu 18.04.1 LTS Release: 18.04 Codename: bionic Architecture: arm64 Uptime: 16:14:56 up 4 min, 1 user, load average: 0.08, 0.02, 0.01 Linux 4.18.0-rc5-1048-ayufan-g69e417fe38cf (rockpro64) 07/27/18 _aarch64_ (6 CPU) avg-cpu: %user %nice %system %iowait %steal %idle 0.54 0.00 0.74 0.39 0.00 98.33 Device tps kB_read/s kB_wrtn/s kB_read kB_wrtn mmcblk0 20.63 634.58 48.26 168380 12804 nvme0n1 0.14 4.01 0.00 1064 0 total used free shared buff/cache available Mem: 3.8G 241M 3.4G 19M 201M 3.5G Swap: 0B 0B 0B ##########################################################################Komplett -> http://ix.io/1ix7

-

-

-

-

-

0.6.59 released

Verschoben Archiv -

DTS DTB Files bearbeiten

Angeheftet ROCKPro64 -

u-boot-flash-spi-rockpro64.img.xz

Verschoben Tools -

bionic-containers-rockpro64

Verschoben Linux